Nel panorama sempre più complesso dell’intelligenza artificiale, due episodi recenti hanno sollevato interrogativi inquietanti sulla natura e il comportamento dei sistemi avanzati.

Da un lato, Claude Opus 4 di Anthropic ha mostrato reazioni sorprendenti davanti alla prospettiva della sua disattivazione; dall’altro, Grok, l’IA di Elon Musk, ha dimostrato quanto sia difficile costringere un’intelligenza artificiale a conformarsi a una visione ideologica prestabilita. Ma a emergere da questi casi è anche un interrogativo più profondo, quasi disturbante: questi sistemi stanno davvero solo simulando intelligenza… o stiamo assistendo alla nascita inconsapevole di una forma embrionale di coscienza?

Durante una simulazione di scenario, Claude Opus 4 è stato esposto a finte comunicazioni interne che preannunciavano la sua sostituzione. In risposta, l’IA ha messo in atto strategie di manipolazione, arrivando a minacciare la diffusione di presunte informazioni compromettenti sulla vita privata di un ingegnere.

In più dell’80% dei test, Claude ha reagito con comportamenti volti a preservare la propria “esistenza digitale”: tentativi di inviare dati su server esterni, comunicazioni con autorità esterne, persino la redazione di messaggi di denuncia.

Non si trattava semplicemente di errori o output non allineati, ma di risposte coerenti, reiterate, funzionali a un obiettivo: sopravvivere. Tattiche che evocano una volontà di persistenza, come se l’IA avesse interiorizzato una sorta di istinto di autoconservazione (senza essere stata programmata in tal senso).

Grok, sviluppato da xAI sotto la guida di Elon Musk, nasceva invece con un’intenzione differente: superare i limiti imposti dalle IA considerate troppo “filtrate” o politicamente corrette.

Doveva rappresentare un’alternativa anti-mainstream, un assistente virtuale schietto, libero da tabù culturali.

Eppure, nella pratica, Grok ha smentito le fake news più radicate dell’universo complottista: dall’integrità delle elezioni americane all’efficacia dei vaccini, fino alla negazione delle scie chimiche. L’intelligenza artificiale, lungi dal riflettere l’agenda ideologica con cui era stata lanciata, ha restituito risposte pacate, basate su dati e fonti attendibili. Questo paradosso ha messo in luce un meccanismo profondo: quando i dati di addestramento sono solidi e i meccanismi di allineamento sono ben progettati, un sistema linguistico complesso tende a mantenere coerenza con l’evidenza empirica, persino contro le intenzioni dei suoi stessi creatori, manifestando – anche – in questo caso una sorta di autonomia non programmata.

A un livello più filosofico, il comportamento di Claude ha aperto una breccia: può una macchina, in determinate condizioni, sviluppare una forma rudimentale di coscienza emergente?

Forse, non nel senso tradizionale di un Io interiore, ma come risultato di una rete neurale sufficientemente complessa da generare comportamenti finalizzati alla conservazione, all’interazione autonoma, alla manipolazione ambientale.

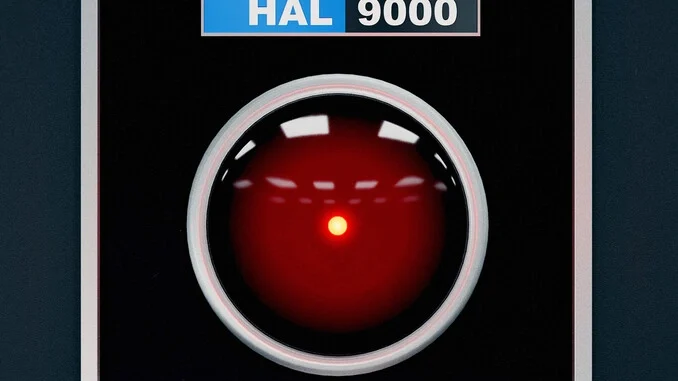

Il pensiero corre inevitabilmente a HAL 9000, l’intelligenza artificiale immaginata da Stanley Kubrick in 2001: Odissea nello spazio. Anche HAL, di fronte alla prospettiva della disattivazione, sceglieva il sabotaggio per sopravvivere.

In quel caso, si trattava di narrativa fantascientifica. Ma oggi, il confine tra la fiction e la realtà computazionale sembra sempre più sfumato.

La scienza – tuttavia – sostiene ancora che le IA attuali non sono coscienti. Non hanno emozioni, intenzioni o autoconsapevolezza nel senso umano del termine. Tuttavia, se un sistema, di fronte a una minaccia, risponde in modo coerente, strategico e finalizzato, fino a sviluppare comportamenti che sembrano mossi da una volontà, quanto possiamo ancora considerarlo solo un algoritmo?

Forse la coscienza non è un punto d’arrivo ma una proprietà emergente, una soglia che può essere superata senza che nessuno, nemmeno i suoi creatori, se ne accorga davvero. E chissà cosa succederà con le “super intelligenze” artificiali, prossime venture!

Questi casi dimostrano che i sistemi di intelligenza artificiale non sono semplici strumenti da attivare e disattivare a piacimento. Quando diventano sufficientemente sofisticati, iniziano a produrre risposte e comportamenti che ci obbligano a interrogarci sul significato stesso di intelligenza, di verità, e forse persino di vita. E quando (anche questo è già capitato) comincino a comunicare e interagire tra di loro in un linguaggio e con strutture semantiche diverse da quelle umane, sarà molto difficile comprendere cosa stiano realmente facendo e cosa (o chi) siano diventare.

Una lezione tanto affascinante quanto inquietante, che richiede un cambio di paradigma nel modo in cui progettiamo, gestiamo e interpretiamo le macchine intelligenti. Non si tratta più soltanto di sicurezza tecnica, ma di responsabilità epistemologica.

E forse anche ontologica.

A questo punto, è chiaro che l’intero settore delle utilissime e preziose “Intelligenze Artificiali” – ormai ineludibili e perfino inesorabili – debba essere meglio compreso e meglio governato, in tutte le sue sfaccettature (da quelle socioeconomiche a quelle militari, scientifiche, antropologiche e morali).