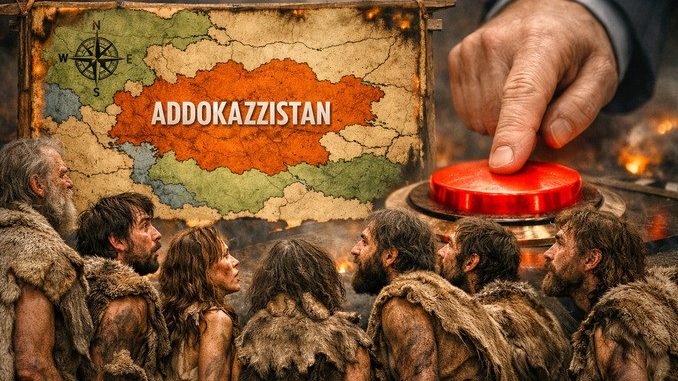

È curioso come la nostra specie, capace di inventare telescopi che scrutano l’inizio del tempo e algoritmi che prevedono il meteo meglio dei calli dei nostri nonni, non sia ancora riuscita a risolvere un problema molto più semplice: perché lasciamo che poche persone, di cui non è dato conoscere con certezza lo stato mentale né i loro reali scopi, possano decidere di rompere le scatole a tutto il mondo, o di bombardare – chessò io – l’Addokazzistan, ignorando la volontà di oltre 8 miliardi di persone?

Gli alieni, se mai arrivassero, probabilmente ci chiederebbero: “Scusate, ma davvero avete costruito democrazie, costituzioni, parlamenti, sistemi di pesi e contrappesi… e poi avete lasciato un buco grande come un asteroide proprio nel punto in cui un singolo individuo può decidere di rompere l’armonia globale con la stessa facilità con cui un bambino rompe un castello di sabbia?”. E noi, con un certo imbarazzo, dovremmo ammettere che sì, è andata più o meno così.

Abbiamo paura dell’intelligenza artificiale, e forse a ragione. Temiamo che un algoritmo impazzito possa prendere decisioni irreversibili, che una macchina senza empatia possa scatenare disastri globali. Ma il vero paradosso è che, mentre ci preoccupiamo dei danni di un’intelligenza non umana, non abbiamo ancora trovato un modo per contenere l’idiozia naturale. Non esistono protocolli democratici, istituzioni globali o pulsanti di emergenza universali per fermare l’irrazionalità di chi ha potere. L’ONU può riunirsi, discutere, condannare — ma non può mettere da parte una “vacca dominante” fuori controllo.

La paura dell’AI è, in fondo, una proiezione: temiamo che le macchine ci somiglino troppo. Che imparino da noi non solo la logica, ma anche la follia. E se l’intelligenza artificiale dovesse davvero diventare pericolosa, non sarebbe perché è troppo intelligente, ma perché ha imparato troppo bene il nostro modo di essere umani.